Gemma 4: L’Intelligenza Artificiale dei pesi aperti

Gemma 4: l’AI open-weight di Google che porta più controllo, privacy e personalizzazione

In un panorama sempre più dominato dagli strumenti di intelligenza artificiale, i Large Language Models (LLM) stanno rivoluzionando il modo in cui interagiamo con la tecnologia. Tra questi, emerge Gemma 4, un modello sviluppato da Google DeepMind. Ma cosa lo rende speciale? Come funziona a livello tecnico e in che modo si distingue dalla concorrenza?

Ecco una guida completa su Gemma 4.

Parte 1: Che cos’è Gemma 4 e come funziona?

Alla sua base, Gemma 4 è una famiglia di LLM open-weight. Questo significa che non stiamo parlando soltanto di un chatbot da usare via web, ma di modelli i cui pesi possono essere scaricati, eseguiti, adattati e integrati dentro progetti propri.

Questo cambia molto il quadro rispetto ai modelli accessibili solo tramite API. Con Gemma 4, infatti, non sei obbligato a passare da un servizio esterno per ogni richiesta: puoi decidere di farlo girare in locale, sul tuo hardware o addirittura sul tuo computer personale, all’interno della tua infrastruttura o in ambienti controllati. Inoltre, non hai necessariamente un costo per chiamata come avviene con molti servizi API-based: restano ovviamente da considerare i costi di hardware, energia e gestione dell’infrastruttura.

Un altro punto chiave è che Gemma 4 può essere eseguito anche offline, nelle configurazioni compatibili. Questo significa che, se installato correttamente in locale, può continuare a funzionare anche senza connessione Internet. E può farlo su computer alla portata di tutti: io sto usando la versione intermedia, la e4b, su un macbook con M1 Pro !

Ed è qui che entra il tema privacy. Gemma 4 non è privato per definizione solo perché è open-weight: la privacy dipende sempre da dove lo esegui e da come costruisci l’applicazione intorno al modello. Ma se scegli un deployment locale o on-premise, puoi evitare di inviare prompt, documenti e dati sensibili a servizi cloud di terzi, mantenendo il trattamento delle informazioni dentro un perimetro molto più controllato o addirittura blindato.

La logica di base: la predizione del token successivo

Dal punto di vista tecnico, Gemma 4 resta un Large Language Model. Non conosce il mondo come farebbe una persona, ma lavora riconoscendo pattern statistici all’interno del linguaggio.

Il principio fondamentale su cui opera è la predizione del token successivo. Quando riceve un prompt, non recupera una risposta già pronta da un archivio nascosto: analizza la sequenza di parole o token ricevuti, valuta il contesto e calcola quali token abbiano la probabilità più alta di venire dopo, generando così la risposta passo dopo passo.

Perché è diverso da molti altri strumenti AI

La differenza sostanziale è che Gemma 4 non è solo un modello da interrogare, ma una base tecnologica che può essere portata dentro prodotti, processi e ambienti aziendali. Può essere usato come assistente locale, come motore per chatbot interni, come supporto allo sviluppo software, come componente per flussi documentali o come modello specializzato tramite fine-tuning.

È proprio questo il punto che rende interessante Gemma 4 anche in ottica progettuale: non solo come tecnologia da provare, ma come componente da integrare in flussi e strumenti concreti. Quando l’intelligenza artificiale entra davvero nei processi aziendali, il tema non è più soltanto la qualità della risposta, ma la capacità di costruire sistemi utili, governabili e coerenti con il business. In questa prospettiva, può essere utile approfondire anche il tema di AI & Automazione, cioè il modo in cui modelli AI, workflow e integrazioni possono diventare parte operativa dell’organizzazione.

Il processo in breve

- Architettura Transformer: Gemma 4 è costruito utilizzando l’architettura Transformer. Questa architettura consente al modello di attribuire peso alle parole nel contesto, comprendendo relazioni, dipendenze e coerenza tra i diversi elementi di una frase.

- Training massivo: il modello viene pre-addestrato su grandi quantità di dati. In questa fase apprende strutture linguistiche, regolarità sintattiche, conoscenze diffuse e modalità di scrittura.

- Instruction tuning e varianti specializzate: Gemma 4 può essere distribuito in versioni ottimizzate per seguire meglio istruzioni e interazioni operative, oltre a poter essere adattato a casi d’uso specifici.

- Generazione locale o remota: quando riceve un prompt, il modello genera la risposta token dopo token. La differenza, rispetto a molti servizi chiusi, è che questo processo può avvenire anche nel tuo ambiente locale, se scegli un setup compatibile con le risorse richieste dal modello.

Cosa significa, in pratica, per aziende e professionisti

- Nessun vincolo obbligatorio di connessione continua: nelle configurazioni locali compatibili, Gemma 4 può funzionare anche offline.

- Più controllo sui dati: prompt e documenti possono restare all’interno del tuo ambiente IT, senza uscire verso provider esterni.

- Costi più prevedibili: non dipendi necessariamente da un prezzo per chiamata API, anche se restano da considerare i costi infrastrutturali.

- Maggiore personalizzazione: puoi integrare, testare e adattare il modello più facilmente in base ai tuoi processi e al tuo dominio applicativo.

Questo aspetto diventa ancora più interessante se si guarda al modo in cui l’AI sta cambiando anche la visibilità dei brand. Oggi non conta solo esserci sui motori di ricerca, ma essere compresi, selezionati e restituiti correttamente dai modelli generativi. Per approfondire questo passaggio, può essere utile leggere anche come l’AI cambia il posizionamento dei brand dalla SEO alla GEO.

Parte 2: Perché usare Gemma 4?

Il vantaggio di Gemma 4 non risiede solo nella sua potenza, ma soprattutto nel modo in cui viene reso disponibile.

Del resto, il punto non è solo avere accesso a un modello potente, ma capire che ruolo questi sistemi stanno assumendo nella costruzione della visibilità, dell’autorevolezza e delle raccomandazioni. È la stessa logica che osserviamo nell’Osservatorio AI, dove il comportamento dei modelli generativi viene analizzato per capire come incidano sulla presenza dei brand e sulla loro percezione.

1. L’open-weights: il grande vantaggio

Questo è il suo punto di forza principale. Mentre molti competitor operano come “scatole nere”, dove è possibile interagire solo tramite API senza accedere ai meccanismi interni, Gemma 4 è un modello open-weights.

- Cosa significa? I pesi del modello, cioè i valori numerici che rappresentano la conoscenza appresa durante l’addestramento, sono resi pubblici e scaricabili.

- Perché è importante? Ricercatori e sviluppatori possono scaricare il modello ed eseguirlo su hardware propri, ottenendo un livello di trasparenza e controllo molto più elevato.

2. Privacy e controllo locale

Questo è uno degli aspetti che rende Gemma 4 particolarmente interessante in ambito aziendale. La possibilità di eseguirlo on-premise, su server interni, workstation dedicate o dispositivi propri, cambia infatti il modo in cui si può progettare un sistema di intelligenza artificiale. Non si tratta solo di ottenere risposte utili, ma di farlo mantenendo un presidio molto più diretto sull’intero ciclo del dato.

Poiché è possibile eseguire Gemma 4 on-premise, su server o dispositivi propri, le aziende possono gestire dati sensibili in un ambiente completamente isolato. Non è necessario inviare dati privati a servizi cloud di terzi, con evidenti vantaggi in termini di protezione della privacy e governance del dato.

3. Personalizzazione estrema

È qui che Gemma 4 mostra uno dei suoi vantaggi più rilevanti sul piano applicativo. Un modello generalista può essere molto utile per attività comuni, ma quando entra in contatto con processi specialistici, terminologia tecnica o contesti aziendali complessi, emergono rapidamente i suoi limiti. La differenza tra un assistente “che risponde bene” e uno davvero utile, spesso, sta tutta nella capacità di adattarsi a un dominio preciso.

Se devi creare un sistema capace di parlare il linguaggio del diritto marittimo, della medicina genetica, della meccanica industriale, della compliance o del customer care tecnico, puoi prendere Gemma 4 e sottoporlo a fine-tuning su un dataset proprietario. In questo modo il modello non lavora più soltanto sulla propria base generalista, ma apprende terminologia, strutture di risposta, logiche operative e priorità tipiche del tuo settore.

Il risultato non è semplicemente un modello “più informato”. È un modello che può diventare più pertinente, più coerente e più aderente al contesto reale in cui dovrà operare. Questo significa risposte più allineate al lessico corretto, maggiore precisione nelle spiegazioni, migliore comprensione delle richieste e un comportamento più vicino alle aspettative di chi lo utilizza ogni giorno.

C’è poi un altro aspetto decisivo: la possibilità di personalizzare il modello usando dati proprietari. Manuali interni, procedure operative, FAQ aziendali, documentazione tecnica, ticket risolti, report, glossari di settore e archivi documentali possono diventare la base per creare un assistente che rifletta il patrimonio di conoscenza dell’organizzazione. Questo permette di trasformare un LLM in un asset molto più vicino al modo reale in cui l’azienda pensa, lavora e comunica.

In sintesi, la vera forza della personalizzazione non è solo rendere il modello più competente. È renderlo più utile. Più vicino al settore, più coerente con i processi, più allineato al linguaggio dell’organizzazione e, quindi, più capace di generare valore reale nel lavoro quotidiano.

Parte 3: Come si allena un modello open?

Quando si parla di personalizzare un modello open come Gemma 4, il processo corretto è il fine-tuning, cioè un affinamento mirato su un dominio specifico. In questa fase, il fattore decisivo non è solo la potenza computazionale, ma soprattutto la qualità del dataset utilizzato.

Per trasformare un modello generalista in un assistente esperto di uno specifico settore, ad esempio compliance, diritto tributario, medicina o customer care tecnico, serve un approccio strutturato, diviso in più fasi.

Fase 1: la raccolta del corpus

La conoscenza del modello non deriva da un “allenamento magico”, ma dai dati che gli vengono forniti. Se vuoi che Gemma 4 diventi competente in un ambito preciso, devi costruire un corpus di contenuti che rappresenti davvero la struttura del sapere e il linguaggio di quel settore.

Cosa raccogliere per il dataset di addestramento

- Documenti di riferimento: manuali operativi, normative, leggi, procedure aziendali, verbali, protocolli e documentazione tecnica.

- Esempi di domanda e risposta: sono tra i dati più preziosi, perché mostrano al modello come rispondere correttamente a richieste specifiche.

- Trascrizioni di interazioni reali: email, ticket, chat di supporto o trascrizioni di call aiutano a trasferire al modello anche il tone of voice del brand.

- Terminologia specifica: glossari, definizioni, relazioni tra termini tecnici e lessico di settore.

La qualità batte la quantità

È preferibile avere poche centinaia o migliaia di esempi molto ben scritti, verificati da esperti e coerenti, piuttosto che grandi volumi di contenuti disordinati, ridondanti o poco pertinenti. In un progetto di fine-tuning, la qualità del dataset incide direttamente sull’affidabilità del risultato finale.

Fase 2: la strutturazione e la pulizia dei dati

I dati grezzi non sono immediatamente utilizzabili. Devono essere puliti, normalizzati e presentati in un formato che simuli una richiesta reale o una struttura chiara di istruzioni e risposte.

Pulizia dei dati

- Rimozione del rumore: eliminazione di duplicati, intestazioni inutili, piè di pagina, URL superflui e testo non pertinente.

- Normalizzazione: uniformazione della terminologia, così da evitare varianti incoerenti dello stesso concetto.

Formattazione del prompt

Un LLM non viene affinato semplicemente caricando documenti in blocco. Gli servono esempi strutturati di interazione. Per questo il dataset viene spesso organizzato come una sequenza di istruzioni, prompt e risposte attese.

[Istruzione]: Sei un esperto di diritto commerciale.

[Prompt]: Quali sono i requisiti di un contratto di mandato?

[Risposta attesa]: Un contratto di mandato richiede la nomina del mandatario, l'accettazione da parte del mandante e la definizione chiara delle condizioni operative.Fase 3: il fine-tuning tecnico

Questa è la fase più tecnica. In genere non si riaddestra da zero l’intero modello, perché sarebbe estremamente costoso. Si usano invece tecniche di Parameter-Efficient Fine-Tuning, come LoRA o QLoRA, che consentono di intervenire solo su una parte limitata dei parametri.

Cos’è LoRA

LoRA consente di adattare un modello pre-addestrato modificando solo una piccola frazione dei suoi parametri. In questo modo si preserva la conoscenza generale del modello, come grammatica e linguaggio, e si innestano competenze nuove, specifiche del dominio che interessa.

Cosa succede in pratica

Si carica Gemma 4 insieme al dataset preparato. Il sistema apprende a rispondere meglio a prompt legati al settore target, aggiornando solo le componenti necessarie. Questo rende il processo più sostenibile dal punto di vista economico e più realistico per aziende, laboratori di ricerca e team di sviluppo.

Risorse necessarie

Per il fine-tuning servono in genere GPU di fascia alta oppure infrastrutture cloud dedicate. L’entità delle risorse richieste dipende dalla dimensione del modello, dalla quantità di dati e dal livello di ottimizzazione del progetto.

Fase 4: testing, revisione e deployment

Il lavoro non termina con la fine dell’addestramento. Un modello affinato va testato in profondità, validato da persone competenti e poi integrato nell’applicazione finale.

- Testing: il modello deve essere messo alla prova con scenari non presenti nel dataset, per valutarne la capacità di generalizzare.

- Validazione umana: un esperto di dominio deve controllare le risposte, identificare eventuali errori o allucinazioni e correggere i dati dove necessario.

- Deployment: quando le performance risultano stabili, il modello viene integrato nel chatbot, nell’assistente interno o nell’API che lo renderà operativo.

Riepilogo operativo

Checklist essenziale per allenare un modello open

| Obiettivo | Azione chiave | Output finale |

|---|---|---|

| Conoscenza | Raccogliere documenti, procedure e coppie domanda-risposta. | Un dataset strutturato e pulito. |

| Comportamento | Definire tono di voce, stile e modalità di risposta. | Esempi coerenti di conversazione. |

| Addestramento | Applicare tecniche come LoRA o QLoRA al modello base. | Un modello affinato sul dominio. |

| Controllo | Testare scenari complessi e correggere errori o allucinazioni. | Un assistente più affidabile e pronto all’uso. |

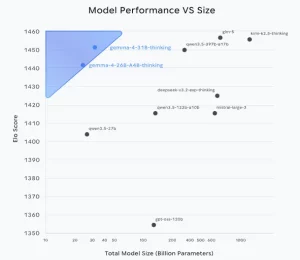

Parte 4: Gemma vs altri LLM a chatbot

Quando si confrontano modelli come Gemma 4 con sistemi chiusi come GPT-5 o Claude, la differenza cruciale non riguarda solo la qualità della risposta, ma soprattutto la filosofia di sviluppo, l’accessibilità e il livello di controllo lasciato all’utente.

Confronto tra modelli open-weights e modelli proprietari

| Caratteristica | Modelli a pesi aperti (es. Gemma 4) | Modelli proprietari e chiusi (es. GPT-5, Claude) |

|---|---|---|

| Accessibilità | Alta. I pesi sono scaricabili. | Limitata. Si accede solo tramite API. |

| Trasparenza | Massima. I ricercatori possono ispezionare e modificare il modello. | Minima. Il funzionamento interno non è accessibile. |

| Privacy e deployment | Eccellente. Possibilità di eseguire il modello localmente. | Dipendente dal cloud. Richiede invio di dati a servizi esterni. |

| Personalizzazione | Profonda. Permette fine-tuning su dati privati. | Limitata. Si può aggiungere contesto, ma non modificare il modello di base. |

| Controllo | Totale. L’utente decide dove e come eseguire il modello. | Ridotto. L’utente dipende dalle politiche del fornitore. |

In sintesi: chi dovrebbe usare cosa?

- Scegli Gemma 4 se: sei uno sviluppatore, un ricercatore o un’azienda che gestisce dati sensibili e ha bisogno di controllo totale sul modello. Se privacy, hosting locale e personalizzazione sono priorità strategiche, Gemma 4 rappresenta una scelta molto forte.

- Scegli i modelli proprietari se: cerchi la massima semplicità d’uso, non hai particolari vincoli sulla privacy o sull’hosting locale e vuoi ottenere risultati immediati con il minimo sforzo operativo.

Conclusione

Gemma 4 non vuole essere semplicemente un altro chatbot potente. Rappresenta piuttosto una dichiarazione di intenti: l’intelligenza artificiale può essere più trasparente, più personalizzabile e più accessibile.

Per questo il tema non riguarda solo la tecnologia in senso stretto, ma anche il modo in cui le organizzazioni scelgono di adottarla, governarla e integrarla nelle attività quotidiane. Non è un caso che il dibattito sull’intelligenza artificiale si intrecci sempre di più con processi, ruoli, competenze e trasformazione del lavoro. Su questo fronte, un approfondimento utile è anche quello dedicato a nuove opportunità e sfide dell’AI nel lavoro.

Offrendo un modello open-weights di alta qualità, Google mette a disposizione di sviluppatori e imprese fondamenta più solide, più sicure e maggiormente sotto il loro controllo.

FAQ su Gemma 4

Che cos’è Gemma 4?

Gemma 4 è una famiglia di modelli linguistici open-weight. In pratica, non è solo uno strumento da usare online, ma una base tecnologica che può essere scaricata, eseguita e integrata in progetti propri.

Cosa significa che Gemma 4 è un modello open-weight?

Significa che i pesi del modello, cioè i parametri appresi durante l’addestramento, sono resi disponibili. Questo permette a sviluppatori, ricercatori e aziende di eseguire il modello su infrastrutture proprie, studiarlo, adattarlo e usarlo con un livello di controllo molto più elevato rispetto ai modelli accessibili solo via API.

Gemma 4 è gratuito?

Gemma 4 è scaricabile gratuitamente. Non segue necessariamente la logica del costo per chiamata tipica dei servizi AI basati su API. Il modello può essere scaricato e utilizzato, ma questo non significa che il suo utilizzo sia privo di costi: restano da considerare hardware, energia, configurazione, manutenzione e infrastruttura.

Gemma 4 può funzionare senza connessione Internet?

Sì, nelle configurazioni compatibili Gemma 4 può essere eseguito anche in locale e continuare a funzionare senza una connessione continua a Internet. Questo è uno degli aspetti che lo rende interessante per ambienti controllati o per casi d’uso che richiedono maggiore autonomia operativa.

Gemma 4 garantisce automaticamente la privacy?

No. La privacy non dipende solo dal modello, ma soprattutto da dove viene eseguito e da come viene progettata l’applicazione che lo utilizza. Se Gemma 4 gira in locale o on-premise, però, è possibile mantenere prompt, documenti e dati sensibili all’interno del proprio perimetro tecnologico, con un controllo molto più diretto.

Qual è la differenza tra Gemma 4 e un modello proprietario come GPT o Claude?

La differenza principale riguarda il livello di accesso e di controllo. Con un modello proprietario, in genere, si interagisce tramite API e non si ha visibilità sul funzionamento interno. Con un modello open-weight come Gemma 4, invece, è possibile scaricare il modello, farlo girare nel proprio ambiente e adattarlo in modo più profondo alle proprie esigenze.

Come funziona tecnicamente Gemma 4?

Come gli altri grandi modelli linguistici, Gemma 4 si basa sulla predizione del token successivo. Riceve un prompt, analizza il contesto e genera la risposta un token alla volta, costruendo progressivamente un testo coerente.

Gemma 4 può essere personalizzato per un settore specifico?

Sì. Uno dei vantaggi più importanti di Gemma 4 è la possibilità di personalizzarlo tramite fine-tuning. Questo consente di adattare il modello a linguaggi tecnici, procedure, dataset proprietari e casi d’uso specialistici, rendendolo molto più aderente a un dominio preciso.

Che cosa serve per allenare o affinare un modello come Gemma 4?

Serve soprattutto un dataset di qualità, ben strutturato e coerente con il dominio che si vuole coprire. Dal punto di vista tecnico, il fine-tuning viene spesso eseguito con tecniche come LoRA o QLoRA, che permettono di adattare il modello senza doverlo riaddestrare completamente da zero.

Per quali aziende o professionisti ha senso valutare Gemma 4?

Gemma 4 è particolarmente interessante per aziende, team IT, sviluppatori, reparti tecnici, studi professionali e organizzazioni che hanno bisogno di maggiore controllo su dati, infrastruttura e personalizzazione. È una scelta rilevante soprattutto quando privacy, esecuzione locale e specializzazione del modello diventano esigenze concrete del progetto.

Bibliografia e fonti utili

Google AI for Developers: Gemma

Pagina ufficiale dedicata alla famiglia di modelli Gemma, con overview, documentazione e riferimenti tecnici utili per comprendere struttura, utilizzo e casi applicativi.

Google AI for Developers: Gemma 4 model card

Model card ufficiale di Gemma 4, utile per approfondire capacità del modello, deployment, lingue supportate, limiti e scenari di utilizzo.

Google DeepMind: Gemma

Pagina istituzionale di Google DeepMind dedicata a Gemma, utile per inquadrare il progetto, il posizionamento della famiglia di modelli e la visione strategica dietro lo sviluppo.

Google Blog: Presentazione di Gemma 4

Approfondimento pubblicato da Google sul rilascio di Gemma 4, utile per contestualizzare obiettivi, casi d’uso e scenari di sviluppo.

Hugging Face: Gemma

Repository e risorse di community utili per comprendere come i modelli Gemma vengono distribuiti, integrati e sperimentati in ambienti di sviluppo reali.

HT&T Magazine: L’evoluzione dell’intelligenza artificiale oltre le previsioni di Turing

Approfondimento utile per contestualizzare l’architettura Transformer e il percorso evolutivo dei modelli linguistici all’interno del più ampio scenario AI.

Continua a leggere

E fa consumare meno energia.

Per tornare alla pagina che stavi visitando ti basterà cliccare o scorrere.